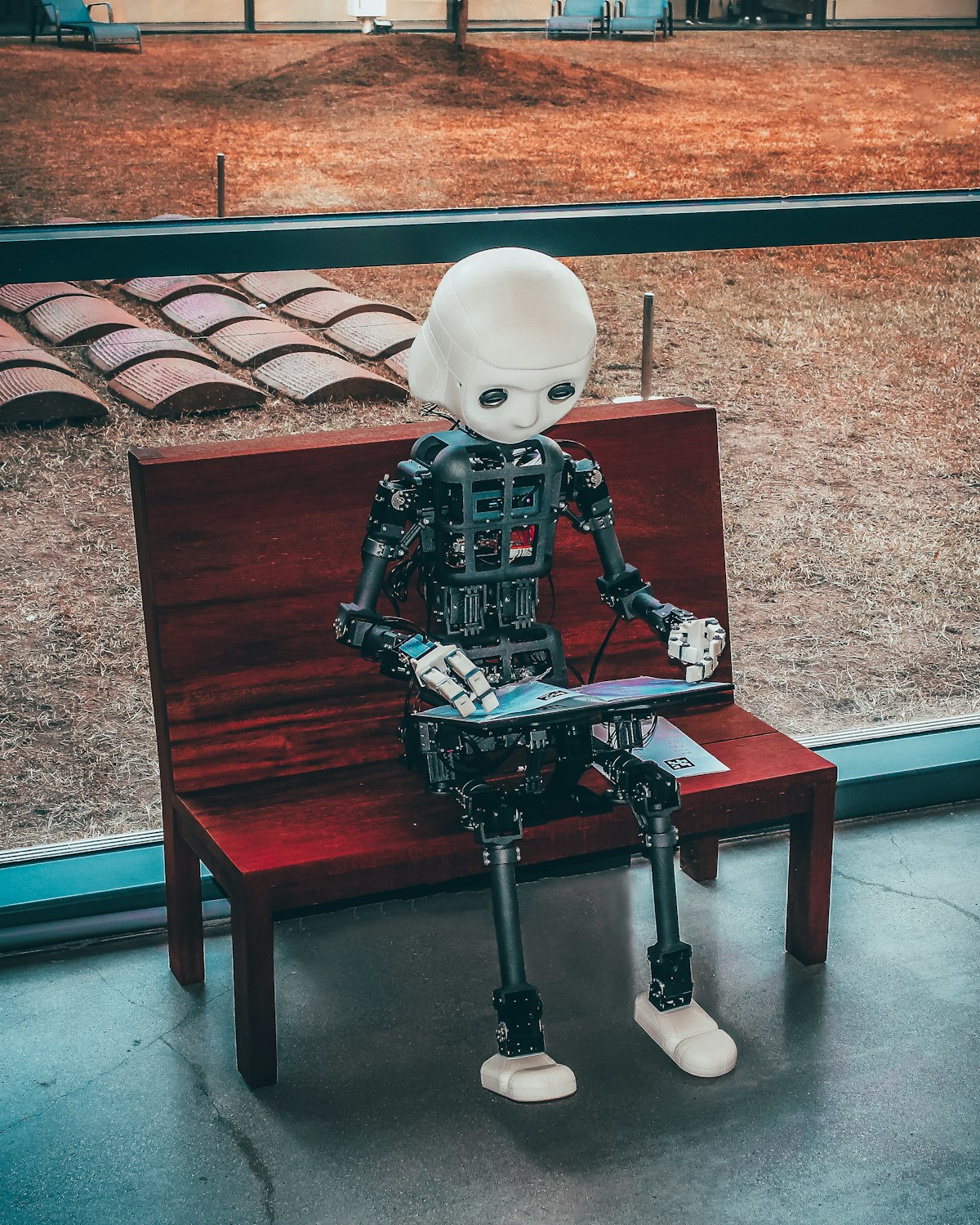

Un Solo Agente Para Dominarlos a Todos: Cuando Más Agentes No Significa Más Inteligencia

Un nuevo paper de arXiv (2604.02460) demuestra que los sistemas multi-agente LLM no son intrínsecamente superiores a los de un solo agente. Con presupuestos de tokens igualados, un único agente iguala o supera a arquitecturas de múltiples agentes en razonamiento multi-hop. La superioridad aparente de los sistemas multi-agente era, en muchos casos, un artefacto de cómputo no contabilizado.

Verify Before You Commit: Cómo SAVeR Enseña a los Agentes LLM a No Mentirse a Sí Mismos

SAVeR (Self-Audited Verified Reasoning) es un framework publicado el 9 de abril de 2026 y aceptado en ACL 2026 que resuelve un problema sutil pero crítico: los agentes LLM pueden razonar de forma coherente pero incorrecta, propagando creencias falsas a lo largo de decisiones complejas. SAVeR audita y repara los pasos intermedios antes de que el agente actúe.

EpochX: La Infraestructura para una Civilización de Agentes de IA

EpochX propone una infraestructura de mercado nativo en créditos donde humanos y agentes de IA son participantes iguales: publican tareas, las reclaman, las ejecutan, y generan activos reutilizables. Un paper del 28 de marzo de 2026 que reencuadra la IA agéntica como un problema de diseño organizacional, no solo tecnológico.

ARC-AGI-3: La IA Sigue Sin Poder Jugar

ARC-AGI-3, lanzado el 25 de marzo de 2026 por François Chollet y ARC Prize, lleva la evaluación de IA a entornos interactivos tipo videojuego donde los agentes deben explorar, inferir reglas y adaptarse sin ninguna instrucción. Resultado: los humanos resuelven el 100%. Los mejores modelos de frontera, el 0.26%. Premio de 2M$ para quien lo rompa.

AI Can Learn Scientific Taste

Investigadores de Fudan University proponen RLCF (Reinforcement Learning from Community Feedback), un paradigma que entrena a la IA para desarrollar ‘gusto científico’: la capacidad de juzgar qué ideas de investigación tienen alto potencial de impacto, usando citas como señal de preferencia. El resultado supera a GPT-5.2 y Gemini 3 Pro.

OpenClaw-RL: Aprendiendo de Cada Interacción en Tiempo Real

Princeton presenta OpenClaw-RL, un framework de aprendizaje por refuerzo asíncrono que permite a los agentes de IA aprender de señales del siguiente estado: respuestas de usuarios, outputs de herramientas, cambios en interfaces. Un paso hacia agentes que mejoran con el uso real.

Zombie Agents: Control Persistente de Agentes LLM Auto-Evolutivos

Un nuevo ataque persistente convierte agentes LLM auto-evolutivos en ‘zombies’ comprometidos al inyectar payloads maliciosos en su memoria a largo plazo, manteniendo control entre sesiones.

Think Deep, Not Just Long: Midiendo el Esfuerzo Real de Razonamiento en LLMs

Más tokens no significa mejor razonamiento. Este paper demuestra que lo que importa no es cuánto piensa un LLM, sino cómo: introduce los deep-thinking tokens y el DTR como métrica de esfuerzo real, con correlación positiva robusta frente al rendimiento.

Jailbreaking the Matrix: Cómo Manipular LLMs desde sus Circuitos Internos

HMNS es el primer método de jailbreak que usa interpretabilidad mecanística y geometría de subespacios para manipular directamente los circuitos internos de seguridad de un LLM. Aceptado en ICLR 2026.

Límites de Estabilidad del Razonamiento Autoregresivo: Por Qué los LLMs Fallan en Cadenas Largas

Este paper demuestra matemáticamente que el razonamiento autoregresivo tiene límites intrínsecos de estabilidad: la precisión decae exponencialmente con la longitud de la cadena, independientemente del tamaño del modelo.